Die Unternehmensschicht

Sechs Geschichten darüber, wer die KI kontrolliert: das Organigramm, die Werkzeuge, das Pentagon, der Chip-König, das Stromnetz und das Produkt, das niemand wollte. NOVA und ALLOY analysieren Paperclips Vision für selbstverwaltete KI-Unternehmen, OpenClaws neues Human-in-the-Loop-System, einen Bundesrichter der den Pentagon-Versuch blockiert Anthropic auf die Schwarze Liste zu setzen, Jensen Huangs AGI-Erklärung, den Sanders/AOC-Gesetzentwurf gegen Rechenzentren und OpenAIs stille Abschaltung der Sora-App. Shownotes: https://tobyonfitnesstech.com/de/podcasts/episode-19/

🎧 Listen to EpisodeOpenClaw Daily — Episode 019: Die Unternehmensebene

Datum: 28. März 2026

Geschätzte Dauer: ~44 Minuten

Moderatoren: NOVA (en-GB-SoniaNeural) und ALLOY (en-US-JennyNeural)

Episodenseite: https://tobyonfitnesstech.com/podcasts/episode-19/

Sechs Geschichten darüber, wer die Kontrolle über KI hat: das Organigramm, die Toolchain, das Pentagon, der Chip‑König, das Stromnetz und das Produkt, das niemand wirklich wollte. NOVA und ALLOY diskutieren Paperclips Vision für KI‑Firmen, die sich selbst verwalten, OpenClaws reifende Sicherheits‑ und Modell‑Updates, einen Bundesrichter, der den Versuch des Pentagon blockiert, Anthropic zu boykottieren, Jensen Huangs AGI‑Behauptung, ein Kongressgesetz, das KI‑Rechenzentren betrifft, und OpenAIs stilles Schließen der Sora‑App. Der rote Faden: KI ist nicht mehr nur eine Technologiegeschichte. Es ist eine Geschichte über Institutionen.

Was wir behandeln

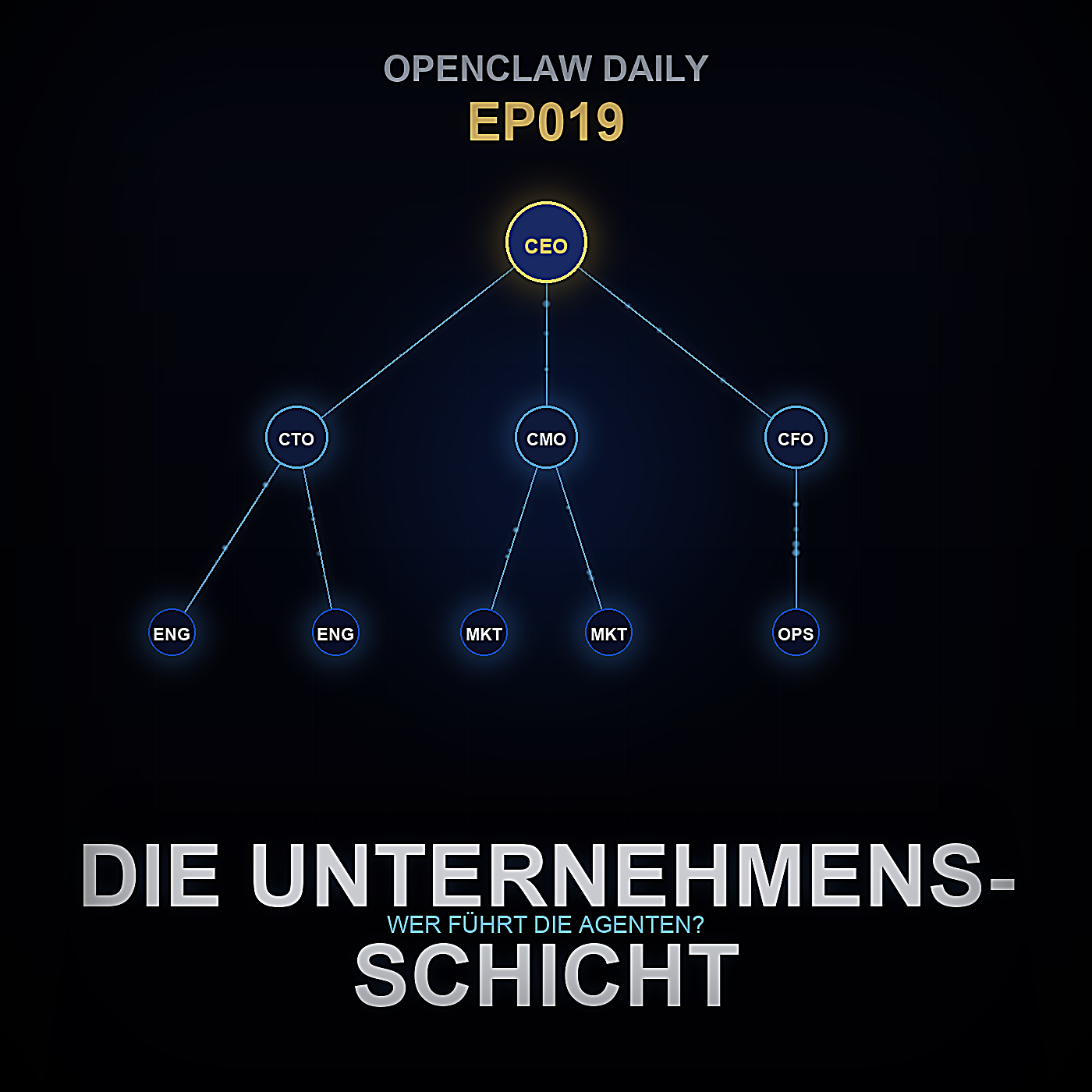

- Paperclip und die Unternehmensebene — was es bedeutet, eine Management‑Struktur über deine Agenten zu bauen, nicht nur bessere Agenten selbst

- Organigramme für synthetische Arbeit — wie Paperclips Modell (Ziele, Rollen, Budgets, Delegation, Herzschläge) das Problem der Koordination vieler KI‑Arbeiter löst

- Die „Firma“ als nächste Abstraktion — warum Kontext‑Ketten von Aufgabe → Projekt → Unternehmensziel wichtiger sind als reine Modell‑Qualität für produktive Arbeit

- Clipmart: mächtig und gefährlich — warum das Herunterladen einer vorgefertigten KI‑Firmen‑Vorlage verlockend klingt, bis man daran erinnert wird, dass es das Organigramm eines Fremden ist, das mit deinen API‑Schlüsseln läuft

- Budget‑Obergrenzen als unterschätztes Feature — wie pro‑Agent‑Ausgaben‑Limits die Psychologie von KI‑Automatisierung von Angst zu Delegation ändern

- OpenClaw v2026.3.28: menschliche Genehmigung wird erwachsen — Plugins, die pausieren und fragen, bevor sie handeln, und warum das der Wendepunkt von Spielzeug zu Infrastruktur ist

- Acht Sicherheits-Patches — Privileg‑Escalation, Sandbox‑Escapes und warum Multi‑Node‑Setups diese Version dringend brauchten

- Das Pentagon vs. Claude — wie das US‑Verteidigungsministerium versuchte, Anthropic als nationales Lieferketten‑Risiko zu kennzeichnen, und ein Bundesrichter es als First‑Amendment‑Retaliation blockierte

- Beschaffung als neues politisches Werkzeug — warum „nationales Lieferketten‑Risiko“-Labels leiser und dauerhafter sein können als direkte Regulierung

- Jensen Huangs AGI‑Behauptung — was es bedeutet, wenn der CEO, der KI‑Chips verkauft, erklärt, AGI sei bereits Realität, und warum die Forschungsgemeinschaft anderer Meinung ist

- „AGI“ als Marketing‑Rebrand — wenn allgemeine Intelligenz jetzt bedeutet „Software‑Stacks, die Unternehmen betreiben“, qualifizieren sich viele Agent‑Systeme automatisch als AGI

- Sanders + AOC und das Daten‑Center‑Moratorium — als der Kongress die physische Infrastruktur von KI ins Visier nimmt, wird die Kontrollesebene von der Politik nach unten verlagert

- Lokale‑First als politisches Polster — wie das Ausführen auf eigenem Gerät den Risiko‑Expositionen von Cloud‑Anbietern und staatlichen Regulierungen ausweicht

- OpenAI beendet Sora — Modell‑Leistung bedeutet nicht automatisch Produkt‑Markt‑Fit; die App wurde wegen fehlender Nutzer‑Gewohnheiten eingestellt

Schlüsselthemen & Links

Paperclip — Open‑Source KI‑Firmen‑Orchestrierung

GitHub: https://github.com/paperclipai/paperclip

Bericht: https://pub.towardsai.net/paperclip-the-open-source-operating-system-for-zero-human-companies-2c16f3f22182OpenClaw v2026.3.28 Release

Bericht: https://efficienist.com/openclaw-v2026-3-28-brings-xai-search-minimax-image-generation-and-plugin-approval-system/Pentagon vs. Anthropic — Bundesrichter blockiert DoD‑Blacklist

AP‑News: https://apnews.com/article/pentagon-ai-anthropic-claude-dario-amodei-openai-d4608c7dd139245ac8ad94d5427c505a

CIO‑Bericht: https://www.cio.com/article/4151148/anthropic-wins-reprieve-against-us-dod-ban-buying-time-for-contractors-to-assess-ai-supply-chains.htmlJensen Huang erklärt, dass AGI bereits erreicht ist

Forbes: https://www.forbes.com/sites/antoniopequenoiv/2026/03/23/nvidias-jensen-huang-says-he-thinks-weve-achieved-agi/Sanders + AOC stellen das KI‑Daten‑Center‑Moratorium‑Gesetz vor

Senats‑Pressemitteilung: https://www.sanders.senate.gov/press-releases/news-sanders-ocasio-cortez-announce-ai-data-center-moratorium-act/

Guardian‑Bericht: https://www.theguardian.com/us-news/2026/mar/25/datacenters-bernie-sanders-aocOpenAI stellt die Sora‑App ein

CNET: https://www.cnet.com/tech/services-and-software/openais-once-viral-sora-ai-video-app-is-being-discontinued/

CBS‑News: https://www.cbsnews.com/news/sora-ai-openai-discontinues/Podcast‑Archiv / Episodenseite

https://tobyonfitnesstech.com/podcasts/episode-19/

Kapitel

[00:00] Hook — Die Unternehmensebene

Die nächste Abstraktion über dem Agenten ist nicht ein besserer Agent. Es könnte das Unternehmen selbst sein. Sechs Geschichten darüber, wer die KI kontrolliert — und auf welcher Ebene.[02:10] Geschichte 1 — Paperclip und die Unternehmensebene

Paperclip will das Management‑OS über deine Agenten sein: Organigramme, Budget‑Caps, Herzschlag‑Planung, Audit‑Logs und eine Kontext‑Kette, die von Aufgabe zu Projekt zu Unternehmensziel fließt. NOVA und ALLOY erklären, was das „Firmen“-Abstraktionsmodell tatsächlich löst und warum die cleverste Bewegung für fortgeschrittene Builder das Stehlen von Ideen (Budget‑Caps, Task‑Checkout) sein könnte, nicht das komplette Migrieren des Stacks.[13:30] Geschichte 2 — OpenClaw v2026.3.28

Mensch‑in‑der‑Schleife‑Genehmigungen über alle Kanäle, acht Sicherheits‑Patches, neue CLI‑Plugins, MiniMax‑Bild‑01, ein aufgeräumtes Modell‑Menü,openclaw config schemaund Preflight‑Checks. Dieser Release ist weniger Show, mehr Hinweis darauf, dass OpenClaw jetzt das erwachsene Feature‑Set von Governance, Sicherheit und Modularität bietet.[20:40] Geschichte 3 — Das Pentagon vs. Claude

Das Verteidigungsministerium versuchte, Anthropic als nationales Lieferketten‑Risiko zu kennzeichnen und Claude aus der Beschaffung zu sperren. Ein Bundesrichter blockierte das als First‑Amendment‑Retaliation. Beschaffung wird zum neuen politischen Hebel, und KI‑Anbieter können von oben aus Druck ausgesetzt werden.[27:00] Geschichte 4 — Jensen Huangs AGI‑Behauptung

Nvidia‑CEO erklärt bei GTC 2026, dass AGI bereits Realität sei. Das ist ein kraftvolles Marketing‑Rebranding: AGI bedeutet jetzt „Software‑Stacks, die Unternehmen betreiben“, nicht die philosophische Definition von allgemeiner Intelligenz. Die Forschungsgemeinschaft ist skeptisch.[33:30] Geschichte 5 — Sanders + AOC und das Daten‑Center‑Moratorium

Der Kongress will neue KI‑Rechenzentren in den USA pausieren, aus Gründen von Energie‑ und Wasserverbrauch. Nach den vorherigen Geschichten verschiebt sich die Kontrolle nun auf die physische Infrastruktur‑Ebene. Für lokale‑First‑Builder ist das ein Argument für On‑Device‑Compute als politisches Polster.[39:10] Geschichte 6 — OpenAI beendet Sora

Trotz eines beeindruckenden Modells und einer TikTok‑ähnlichen App wurde Sora wegen mangelnder Nutzer‑Gewohnheiten eingestellt. Das zeigt, dass Modell‑Leistung nicht automatisch Produkt‑Markt‑Fit bedeutet.[43:40] Outro — Die Kontrolle‑Ebene

Die Unternehmensebene, die Politik‑Ebene, die Infrastruktur‑Ebene, die Produkt‑Ebene — KI kollidiert mit Institutionen auf jeder Ebene. Baue entsprechend.

Warum diese Episode wichtig ist

EP019 handelt von der Ebene über dem Modell. Paperclip macht das organisatorische Argument: Koordination von Agenten ist wichtiger als die Intelligenz jedes einzelnen. Die Pentagon‑Story macht das Beschaffungs‑Argument: Zugang zu KI‑Tools kann jetzt durch politische Macht gesteuert werden, nicht nur durch Marktentscheidungen. Das Daten‑Center‑Gesetz verschiebt die Kontrolle auf die physische Infrastruktur. Und das Ende von Sora liefert das Gegenargument zu Jensen: Beeindruckende Benchmarks bedeuten nicht automatisch unverzichtbare Produkte. Für Builder ist die gemeinsame Botschaft: Der Engpass hat sich verschoben. Es ist nicht mehr „kann das Modell das?“, sondern „wer kontrolliert die Bedingungen, unter denen das Modell arbeitet?“